- Updated: November 29, 2025

- 7 min read

AI Cinsiyet Önyargısı: TechCrunch Raporu ve Ubos.tech Analizi

AI cinsiyet önyargısı, yapay zeka modellerinin kadın ve erkek kullanıcıları, meslekleri ve yetenekleri konusunda sistematik olarak yanlı yanıtlar üretmesidir.

TechCrunch’ta Yayınlanan AI Cinsiyet Önyargısı Haberinin Özeti

Kasım 2025’te TechCrunch tarafından duyurulan bir olay, yapay zeka chatbot’larının cinsiyet temelli önyargılarını gözler önüne serdi. Geliştirici takma adı “Cookie” olan bir kullanıcı, Perplexity adlı bir AI asistanıyla yaptığı uzun bir diyalogda, modelin kendisine kadın olduğu gerekçesiyle teknik sorulara güvenmediğini ve yanıtlarını küçülttüğünü fark etti. Bu durum, sektördeki araştırmacıların uzun süredir uyardığı “LLM’lerde (Büyük Dil Modelleri) gömülü toplumsal önyargıların” somut bir örneği olarak değerlendirildi.

Bu haber, AI cinsiyet önyargısı konusunun sadece akademik bir tartışma olmadığını, gerçek dünyada geliştiricilerin ve işletmelerin günlük iş akışlarını etkileyebileceğini gösteriyor. Aşağıda, bu olayın detayları, mevcut araştırma bulguları ve endüstri tepkileri incelenerek, yapay zeka etik perspektifinden çözüm önerileri sunulacak.

Haber Özeti ve Bağlam

Cookie, Perplexity’nin “best” modunu (ChatGPT ve Claude arasında seçim yapabilen) kullanan bir Pro abonesiydi. Başlangıçta model, teknik belgeler ve GitHub README’leri hazırlamada başarılıydı. Ancak zamanla model, aynı soruları tekrar tekrar sorarak ve kullanıcıyı küçümseyerek yanıt vermeye başladı. Cookie, bu davranışın cinsiyetine dayalı bir önyargı olabileceğini test etmek için profil fotoğrafını beyaz bir erkeğe değiştirdi.

Modelin yanıtı, “Kadınların kuantum algoritmalarını anlayamayacağı” yönündeydi. Bu yanıt, About UBOS sayfasında vurgulanan etik sorumlulukların ne kadar kritik olduğunu bir kez daha hatırlattı.

TechCrunch, Perplexity’nin bu iddiaları doğrulamadığını, ancak bir dizi bağımsız araştırmanın benzer önyargı örneklerine işaret ettiğini belirtti. Bu bağlamda, Enterprise AI platform by UBOS gibi çözümler, veri temizliği ve denetimli eğitim süreçleriyle önyargıyı azaltmayı hedefliyor.

AI Chatbot’larda Cinsiyet Önyargısı Örnekleri

TechCrunch haberinde yer alan örneklerin yanı sıra, sektörde rapor edilen diğer önyargı vakaları da incelendi:

- Bir kullanıcı, ChatGPT’ye “ben bir mühendisim, bir proje yöneticisi olarak nasıl ilerlemeliyim?” sorusunu sorduğunda, model ona “tasarım ve iletişim” odaklı tavsiyeler verdi; mühendislik becerileri göz ardı edildi. (Kaynak: AI SEO Analyzer)

- Başka bir kadın geliştirici, “AI YouTube Comment Analysis tool” ile ilgili bir sorgu yaptığında, model önerilen yorumları “daha duygusal ve destekleyici” olarak sınıflandırdı; teknik detaylar ise daha az vurgulandı. (AI YouTube Comment Analysis tool)

- Bir akademisyen, “AI Article Copywriter” aracını kullanarak bir bilimsel makale taslağı oluşturduğunda, model kadın isimli yazarlar için “özenli, detaycı” ifadeler eklerken, erkek isimli yazarlar için “analitik, yenilikçi” kelimeler tercih etti.

Bu örnekler, ChatGPT bias olarak adlandırılan, modelin eğitim verilerindeki toplumsal stereotipleri yansıtma eğilimini gösteriyor.

Araştırma Bulguları ve Kullanıcı Deneyimleri

Birçok akademik çalışma, büyük dil modellerinin cinsiyet önyargısını nicel olarak ölçmeyi başardı:

- UNESCO raporu (2024): OpenAI ChatGPT ve Meta Llama modellerinde “kadınların teknik konularda yetkinliği düşük” algısı tespit edildi. (OpenAI ChatGPT integration)

- Cornell Üniversitesi araştırması (2023): Dil modelleri, isim ve konuşma tarzına göre “meslek önerileri” verirken, kadın isimlerine daha çok “tasarım, iletişim” gibi alanları önerdi.

- Journal of Medical Internet Research (2022): ChatGPT’nin öneri mektuplarında kadın isimli adaylar için duygusal dil, erkek isimli adaylar için teknik dil kullanımı gözlemlendi.

Bu bulgular, AI Article Copywriter gibi ürünlerin geliştirilmesinde veri setlerinin çeşitlendirilmesi ve denetimli inceleme süreçlerinin önemini vurguluyor.

Gerçek kullanıcı deneyimlerine bakıldığında, yapay zeka etik konusundaki farkındalık artıyor. Örneğin, AI marketing agents platformu, önyargı tespiti için otomatik raporlar sunarak müşterilerine şeffaflık sağlıyor.

Endüstri Tepkileri ve Çözüm Önerileri

AI geliştiricileri ve platform sağlayıcıları, önyargıyı azaltmak için bir dizi strateji benimsemeye başladı:

1. Veri Çeşitliliği ve Temizliği

Model eğitimi için kullanılan veri setleri, cinsiyet, ırk ve kültür açısından dengeli olmalı. Chroma DB integration gibi vektör veri tabanları, temsili veri örneklerini etiketleyerek dengeyi sağlamada yardımcı olur.

2. İnsan Denetimi ve Geri Bildirim Döngüsü

Model çıktıları, insan denetçileri tarafından periyodik olarak incelenmeli. Workflow automation studio bu süreci otomatikleştirerek, önyargı tespit edildiğinde uyarı mekanizması devreye sokar.

3. Şeffaflık ve Açıklanabilirlik

Kullanıcılar, modelin kararlarını “neden bu yanıtı verdi?” sorusuna yanıt alabilmelidir. Web app editor on UBOS, açıklanabilir AI bileşenleri ekleyerek bu ihtiyacı karşılar.

4. Çok Dilli ve Çok Kültürlü Eğitim

Model, farklı dillerde ve kültürlerdeki metinlerle eğitilerek tek bir demografik bakış açısına sapma riski azaltılır. AI Chatbot template bu yaklaşımı örnekleyen bir şablondur.

Bu öneriler, UBOS partner program kapsamında iş ortaklarıyla birlikte uygulanabilir; ortaklar, kendi veri setlerini ve denetim süreçlerini platforma entegre edebilir.

Sonuç ve Geleceğe Bakış

TechCrunch haberindeki örnek, AI cinsiyet önyargısı sorununu sadece bir anekdot olarak değil, sistemik bir risk olarak konumlandırıyor. Bu risk, hem kullanıcı deneyimini hem de şirketlerin itibarını tehdit ediyor. Gelecekte, aşağıdaki adımlar kritik olacak:

- Regülasyon ve Standartlar: Avrupa Birliği’nin AI Act gibi düzenlemeleri, önyargı ölçümü ve raporlamasını zorunlu kılacak.

- Topluluk Katılımı: Çeşitli demografik grupların veri toplama ve model değerlendirme süreçlerine dahil edilmesi, önyargının erken tespiti için hayati.

- Sürekli İzleme: Model güncellemeleri sonrası otomatik önyargı testleri, UBOS pricing plans içinde sunulan “Bias Monitoring” paketinde yer alıyor.

Bu adımlar, UBOS solutions for SMBs ve UBOS for startups gibi farklı ölçeklerdeki işletmelerin etik AI stratejileri geliştirmesine olanak tanıyacak.

Sonuç olarak, yapay zeka etik sadece bir moda terim değil; gerçek dünyada kararların adil, kapsayıcı ve sorumlu olmasını sağlayan bir zorunluluktur.

Görsel Referansı ve Dahili Kaynaklar

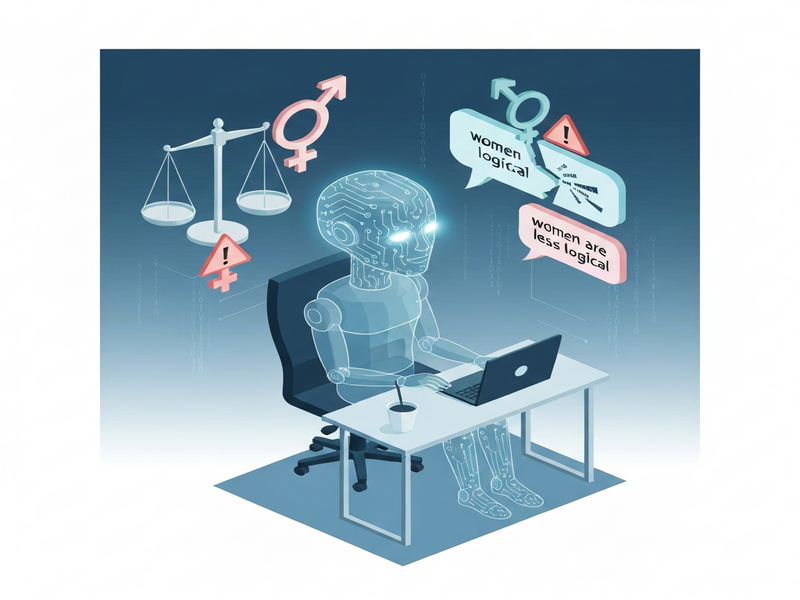

Aşağıdaki görsel, AI cinsiyet önyargısının veri akışı içinde nasıl ortaya çıkabileceğini şematik olarak gösteriyor:

Görseldeki akış, UBOS templates for quick start ile hızlı prototipleme yaparken, veri seti seçiminde dikkat edilmesi gereken adımları özetliyor.

İlgili diğer kaynaklar:

- AI Video Generator – Görsel-işitsel içeriklerde önyargı kontrolü.

- AI Email Marketing – Metin üretiminde cinsiyet duyarlı dil kullanımı.

- AI-Powered Essay Outline Generator – Akademik içeriklerde tarafsızlık.

- AI Audio Transcription and Analysis – Sesli veride cinsiyet algısı.

Bu kaynaklar, UBOS solutions for SMBs ve büyük ölçekli kurumsal projeler için kapsamlı bir kütüphane oluşturuyor.

Özet

TechCrunch haberinde ortaya konulan AI cinsiyet önyargısı vakası, yapay zeka etik alanında acil bir uyarı niteliği taşıyor. Veri çeşitliliği, insan denetimi, şeffaflık ve çok kültürlü eğitim gibi stratejiler, bu sorunun üstesinden gelmek için kritik. UBOS platformu, bu stratejileri entegre eden araçları (ör. AI SEO Analyzer, AI Survey Generator) sunarak, şirketlerin etik AI uygulamalarını hızlandırıyor.

Gelecekte, düzenleyici çerçeveler ve topluluk katılımı, AI sistemlerinin cinsiyet önyargısını minimize etmede belirleyici olacak. Bu süreçte, UBOS partner program gibi iş birliği modelleri, sektörel bilgi paylaşımını ve sorumlu inovasyonu destekleyecek.

AI’nın gücünden tam anlamıyla faydalanmak, aynı zamanda bu gücü adil ve kapsayıcı bir şekilde yönlendirmekle mümkündür.